GitHub 2.3k星的DeepSeek-TUI,用Rust编写的终端编程工具,针对DeepSeek V4优化,支持100万token上下文、多子Agent并行、三种操作模式。

GitHub 2.3k星的DeepSeek-TUI,用Rust编写的终端编程工具,针对DeepSeek V4优化,支持100万token上下文、多子Agent并行、三种操作模式。

DeepSeek-TUI 是一个用 Rust 编写的终端编程 Agent,可以理解为 "DeepSeek 版 Claude Code"。它在终端里运行,专门针对 DeepSeek V4 做了优化适配,GitHub 上已经收获 2.3k 星标。

DeepSeek-TUI 运行界面

思维链实时可见:DeepSeek-TUI 把模型的推理过程直接流式输出到终端,模型怎么分析问题、走了哪条路、中途有没有改主意,全部实时可见。

100万 token 上下文:项目默认用满 DeepSeek V4 支持的 100 万 token 上下文窗口。上下文快填满时会自动压缩,压缩策略专门考虑了 DeepSeek 的前缀缓存机制。

RLM 多子 Agent 模式:一个主模型指挥最多 16 个 V4 Flash 子任务同时跑,用来做批量分析或任务拆解。Flash 的输出价格大约是 Pro 的三分之一,把不需要强推理的子任务交给它,整体花费能砍不少。

RLM 多子 Agent 并行模式

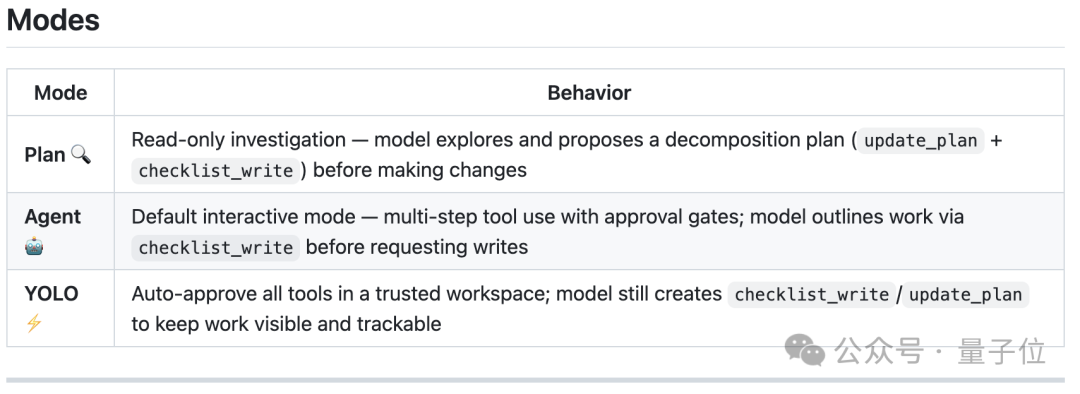

三种操作模式:

| 模式 | 说明 | 适用场景 |

|---|---|---|

| Plan | 只读探索,先出方案不执行 | 了解代码库、制定计划 |

| Agent | 每步工具调用都要你确认(默认) | 日常开发、逐步审查 |

| YOLO | 全自动放行,不打断 | 批量任务、信任度高的操作 |

一行命令安装:

npm install -g deepseek-tuiLinux、macOS、Windows 都有预编译二进制。

配置 API:支持 DeepSeek 官方 API、NVIDIA NIM、Fireworks、自托管 SGLang 等多条路径。

项目地址:github.com/Hmbown/DeepSeek-TUI

GitHub 2.3k星的Rust开源终端编程工具,专为DeepSeek V4优化,支持思维链输出、子Agent调度和MCP服务器

用bggg-creator-image2psd这个开源Skill,把GPT-image-2生成的合并图拆成12层可编辑PSD,文字与图形自动分层,无残影。

估值5亿的AI文档平台Mintlify,让文档同时服务于人类和AI,支持Markdown结构化内容、llms.txt机器目录和MCP实时查询,Anthropic、X、PayPal都在用。