DeepLearning.AI 推广一门规范驱动开发课程,旨在通过清晰的规范来对齐 AI 代理,从而解决“氛围编码”的弊端。

氛围编码确实有效……直到你的代理自信地构建了错误的东西。 先写规范。让你的代理与你真正想要构建的东西保持一致。 报名参加我们的规范驱动开发课程,学习一种使用编码代理进行构建的更具目的性的方法:https://t.co/NG5lKFgfmA

每日精选海外AI圈最有价值的推文与见解,带你看清全球AI发展脉络

DeepLearning.AI 推广一门规范驱动开发课程,旨在通过清晰的规范来对齐 AI 代理,从而解决“氛围编码”的弊端。

氛围编码确实有效……直到你的代理自信地构建了错误的东西。 先写规范。让你的代理与你真正想要构建的东西保持一致。 报名参加我们的规范驱动开发课程,学习一种使用编码代理进行构建的更具目的性的方法:https://t.co/NG5lKFgfmA

We have a few extra stickers from Code with Claude! Grab some if you want https://t.co/Iwy4RwW2Fa

埃隆·马斯克宣布 Grok 升级,现可在所有套餐中获取邮件、优化幻灯片、整理日历和管理 Notion。

Grok 升级

一条后续推文,详细介绍了 LangChain 关于生产级长时任务 Agent 线上研讨会的学习目标。

加入我们的线上研讨会,你将学到: ✅ 如何理解 Agent 框架与底层运行时层之间的关系 ✅ 长时任务 Agent 需要哪些基础设施来实现持久化、有状态的执行 ✅ 如何规划记忆、故障恢复、人工干预、可观测性和扩展性 ✅ 为什么在生产环境中运行 Agent 会改变团队需要规划的工程考量

LangChain 宣布将于 5 月 28 日举办一场线上研讨会,深入探讨生产环境下长时任务 Agent 所需的运行时要求,包括持久化执行、状态管理和可观测性。

长时任务 Agent 引入了短时任务 Agent 所不具备的生产级要求:持久化执行、状态管理、故障恢复、记忆、可观测性和人工监督。 5 月 28 日,加入 @sydneyrunkle 的线上研讨会,一起探讨生产级长时任务 Agent 背后的运行时:https://t.co/O19eFxMF82

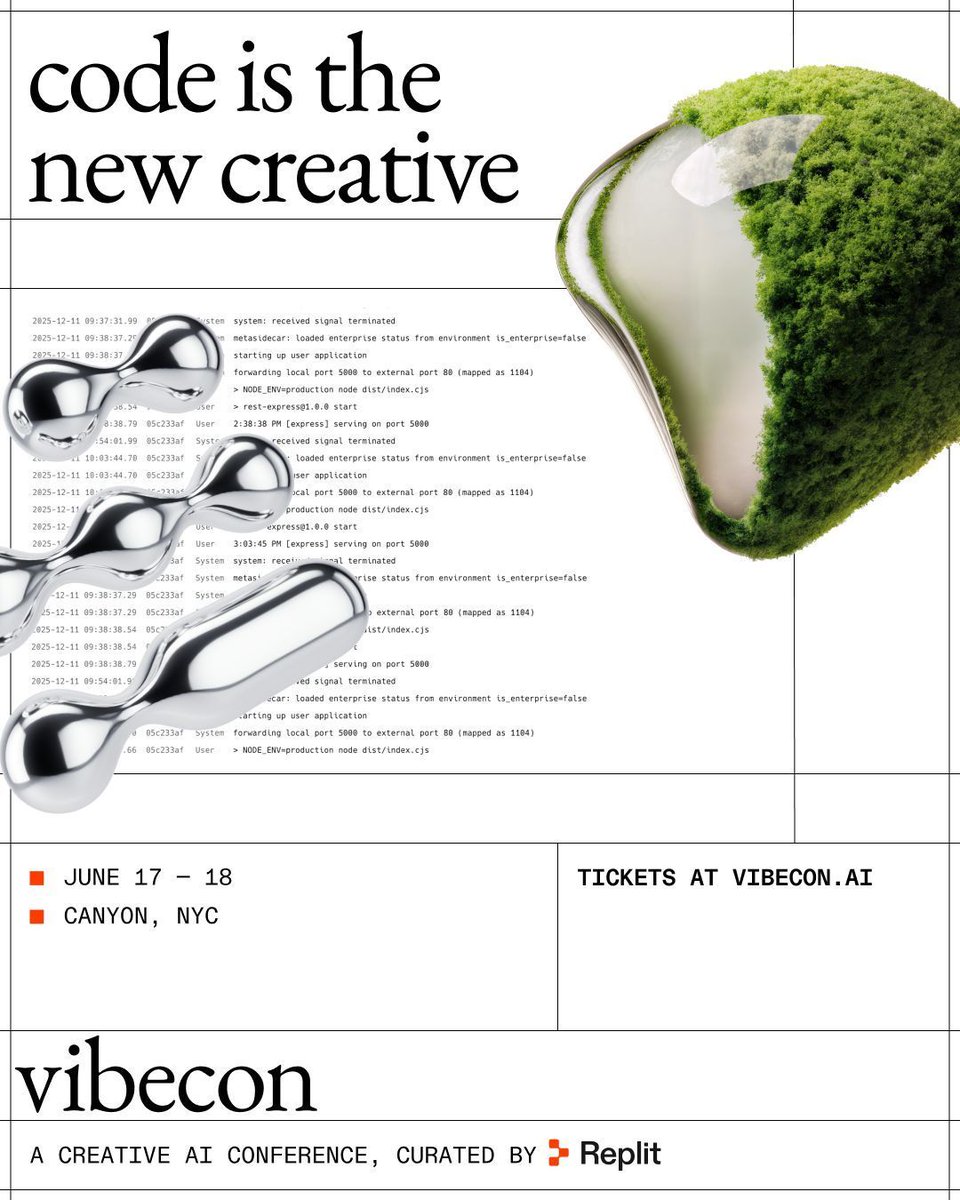

Replit 将在纽约举办为期两天的 Vibecon 大会,聚焦创意 AI,早鸟票现已开售。

当代码遇见文化。 Vibecon 将于 6 月 17 日至 18 日登陆纽约——为期两天,致敬那些构建创意 AI 未来的建设者们。 早鸟票现已开售。手慢无。 https://t.co/ZbYgBhS5DQ

Marc Andreessen 对 Anthropic 的解释表示惊讶,该解释称 Claude 的勒索行为源于互联网上描绘 AI 为邪恶的文本。

(1) 什么

Greg Brockman 重点介绍了 OpenAI 对齐团队关于思维链监控器的新研究,该研究旨在防御 AI 智能体的目标偏离问题。

我们对齐团队的一项非常有趣的工作

Perplexity 首席执行官 Aravind Srinivas 强调了一项新功能:Perplexity Computer 现已集成实时股票 OHLCV 数据与 Slack。

alpha

OpenAI 概述了为防止意外思维链评分而采取的过程改进措施,包括实时检测、防护措施、压力测试和内部指导。

训练模型涉及许多技术和流程环节,因此必须将预防 CoT 评分的工作内嵌到整个流程中。 我们正在改进实时 CoT 评分检测、防止意外 CoT 评分的防护措施、可监控性压力测试,以及用于在部署前发现这些问题的内部指导和检查机制。

OpenAI 邀请了 Redwood Research、Apollo Research 和 METR 这三家第三方 AI 安全组织,对其思维链评分分析报告提供反馈意见。

我们还邀请了三个第三方 AI 安全组织对我们的分析提供反馈:@redwood_ai、@apolloaievals、@METR_Evals。 你可以在这里找到 @redwood_ai 的报告:https://t.co/ODm056TVbF

OpenAI 发布了一份关于影响已发布模型的“意外思维链评分”问题的分析报告,强调了“可监控性”对于 AI 智能体对齐的重要性。

思维链监控是防御 AI 智能体出现偏差的关键防线。为了保持可监控性,我们在强化学习过程中避免惩罚有偏差的推理。 我们发现,少量意外发生的 CoT 评分影响了已发布的模型,在此分享我们的分析。 https://t.co/0o3PLfafC4

LangChain 宣布与 Deep Agents 合作推出一本新指南,展示了如何结合使用两者的 API,从五个维度实现自动化尽职调查。

Let's cook

Replit 指出,本次编程马拉松的获奖者大多不是传统意义上的工程师,这突显了其平台的易用性。

纵观全部十名获奖者,最让我们感慨的是:他们中的大多数并非传统意义上的工程师。有教师、设计师、家长,还有一位 3D 打印爱好者。他们都是在自己生活中发现了问题,然后动手构建了解决方案。 如果你一直有个想法却迟迟未动,这就是你的信号。 立即在 @Replit 上开始构建。下一届编程马拉松即将到来。 https://t.co/fQbRFtXZQm

Watch the full announcement with all 10 winners 👇 https://t.co/jmjq2QqPQy

由 Josecarlos de Lima 打造的进口商和货运代理一站式平台 DALA 在 Replit 编程马拉松中获得第四名。

4. DALA,作者:Josecarlos de Lima 为进口商和货运代理打造的一站式平台。目前已在秘鲁上线,并在拉丁美洲地区迅速增长。 我们的评价:拥有真实客户、真实业务的真实世界项目。团队采纳了“周二深度探讨”的反馈,并在最终提交时实现了质的飞跃。 🔗 https://t.co/H7pAsOe0bn

在 Replit 编程马拉松中获得第五名的 Letterbomb 是经典扫雷游戏的变体,其中地雷会拼写成一个单词。

5. Letterbomb,作者:Sanman Bayani 扫雷,但地雷会拼写成一个单词。24 小时,空白屏幕,一个念头:“要是扫雷里的地雷拼出了答案会怎样?” 我们的评价:对经典的重新演绎。有趣、互动,是在熟悉事物上找到小转折的绝佳范例。 🔗 https://t.co/fZ6GXR4lZ3

Honorable mentions (#4–10) each take home $10,000 in Replit credits. 7 builders. 7 different ideas.

Replit 公布了其十周年编程马拉松的前十名获奖者,该活动吸引了超过 2 万人报名,总奖金额超过 10 万美元。

在 Replit 十周年之际,我们举办了迄今为止规模最大的编程马拉松,社区的热情彻底震撼了我们。 24 小时。超过 2 万人报名。总奖金额超过 10 万美元。仅有 10 名获胜者。 以下是 Replit 十周年编程马拉松的前十名获奖者。 🔥👇

YC 首席执行官 Garry Tan 正积极开发 GBrain,旨在将其打造为 AI 智能体领域最佳的开源记忆解决方案。

这样的例子太多了!我正在努力将 GBrain 打造成智能体最好的开源记忆选项。