DeepSeek 公布多模态推理新技术 Thinking with Visual Primitives,用坐标替代语言描述,在多项视觉推理任务上超越 GPT-5.4 和 Claude Sonnet 4.6

DeepSeek 公布多模态推理新技术 Thinking with Visual Primitives,用坐标替代语言描述,在多项视觉推理任务上超越 GPT-5.4 和 Claude Sonnet 4.6

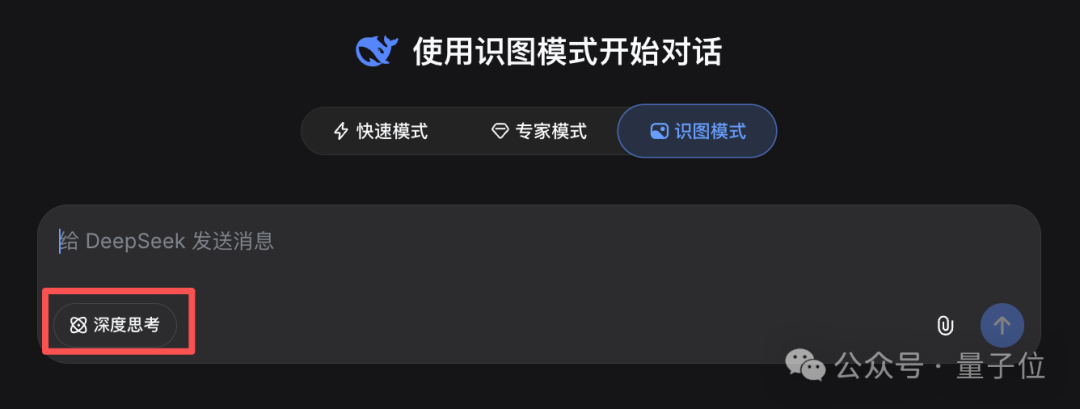

DeepSeek 的多模态能力终于落地了。4 月底,DeepSeek 在网页端和 App 灰度上线了「识图模式」,同时发布了技术报告《Thinking with Visual Primitives(以视觉原语思考)》。这个模型最核心的变化是:在推理时不再只用文字思考,而是像人一样用"坐标"在图片上指指点点,把视觉锚点直接嵌入思维链。

DeepSeek 识图模式使用的是一个 284B 总参数、13B 激活参数的多模态推理模型,基座是 DeepSeek-V4-Flash。它已经可以在 DeepSeek 网页端和 App 中直接体验。

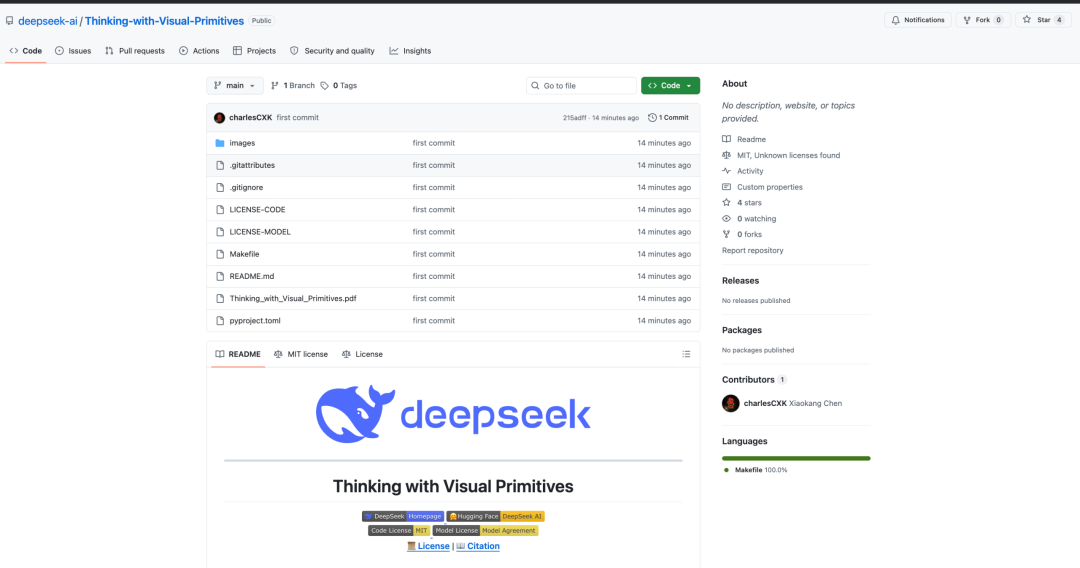

项目地址和技术报告已开源:

传统多模态模型在处理视觉推理时有一个致命问题:用自然语言描述图片中的对象时,描述天然是模糊的。"左边那个大的"、"靠近中央的红色物体"在密集场景里根本无法精确定位,模型越想越乱。

DeepSeek 把这个问题命名为 Reference Gap(指代鸿沟),解法很直接:把边界框(Bounding Box)和点坐标变成推理的基本单位,像文字一样穿插在思维链里。

举个例子,当模型在数图里有几只熊时,推理过程是这样的:

扫描图片寻找熊,找到一只

<|ref|>熊<|/ref|><|box|>[[452,23,804,411]]<|/box|>,它正在爬树,不在地面上,排除。再往左下看,找到另一只<|ref|>熊<|/ref|><|box|>[[50,447,647,771]]<|/box|>,站在岩石边缘,符合条件。

这就像人类在数东西时用手指逐一点过去。坐标不再是答案,而是推理过程中消除歧义的「锚点」。模型有两种视觉原语:边界框(<|box|>)用于定位和尺寸信息,点坐标(<|point|>)用于更抽象的空间指代。

架构层面的压缩同样值得关注。对于一张 756x756 的图片:

整体压缩比达到 7056 倍。对比一下:Claude Sonnet 4.6 处理同等图片需要约 870 个 KV 缓存条目,Gemini-3-Flash 需要约 1100 个。DeepSeek 用不到十分之一的缓存开销,实现了同等级别的推理能力。

识图模式支持开启/关闭深度思考。非思考模式下速度极快,几乎是秒回;开启深度思考后,推理能力大幅提升,但耗时也显著增加(复杂题可能需要 4 分钟以上)。

空间推理题的实测中,非思考模式秒答但容易出错,开启深度思考后正确率明显提升。不过当前版本的思考过程较为冗长,DeepSeek 团队也承认这一点还在优化中。

在 11 个基准测试上与主流模型对比:

| 任务 | DeepSeek | GPT-5.4 | Claude Sonnet 4.6 | Gemini-3-Flash |

|---|---|---|---|---|

| 计数 (Pixmo-Count) | 89.2% | 76.6% | 68.7% | 88.2% |

| 迷宫导航 | 66.9% | 50.6% | 48.9% | 49.4% |

| 路径追踪 | 56.7% | 46.5% | - | 41.4% |

| 空间推理 (MIHBench) | 85.3% | - | - | - |

在拓扑推理任务上优势最为明显,迷宫导航比 GPT-5.4 高出 16 个百分点以上。

提示:识图模式目前处于灰度阶段,如果你还没有看到该功能入口,可以关注 DeepSeek 官方后续的全面开放公告。

GitHub 50K星标的开源桌面工具,支持在Claude Code、OpenClaw等6个Agent中一键切换模型,附带用量追踪和故障转移功能

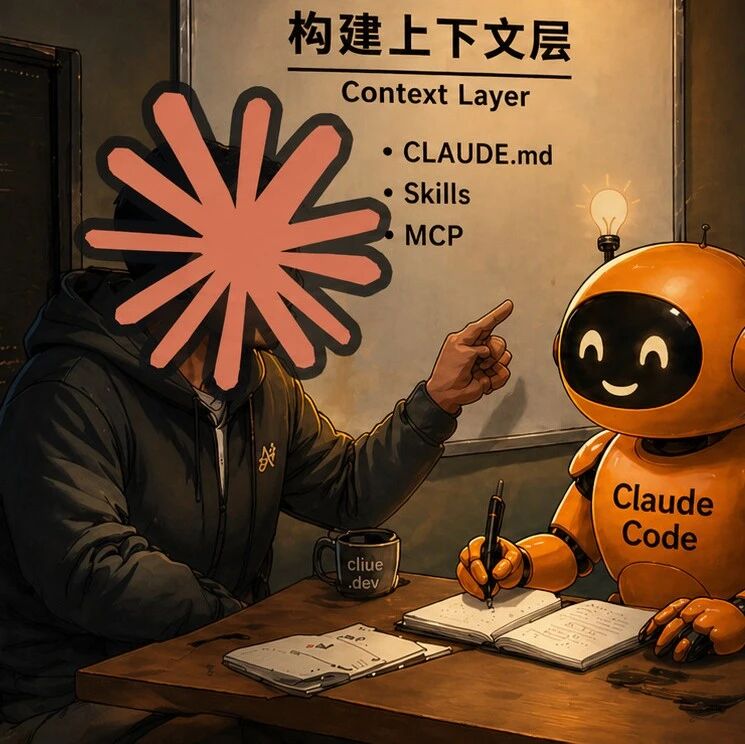

通过CLAUDE.md、Skills和MCP三层上下文构建,让AI真正理解你的代码库,附OpenAI Symphony并行编排方案对比

OpenClaw v2026.4.25版本接入13个语音提供商、OTEL全链路可观测性和插件冷启动优化,让Agent运行透明可控