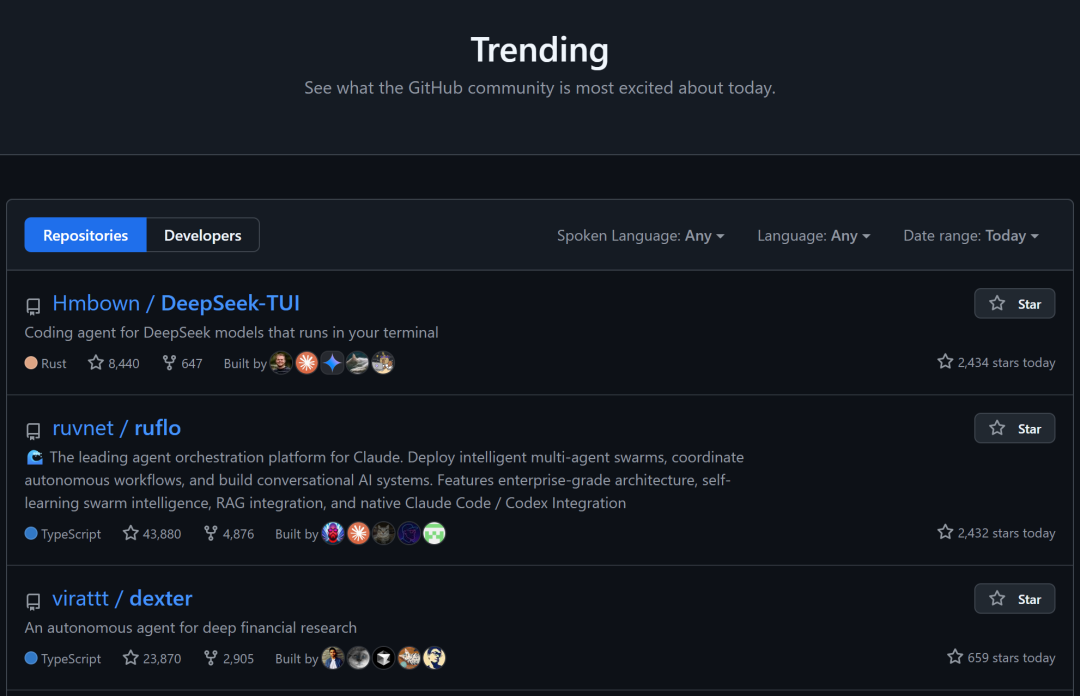

基于 DeepSeek V4 的终端 AI 编程智能体 DeepSeek TUI 在 GitHub 获 8700+ Star,支持思维链可视化、100 万 Token 上下文、16 路并发子任务。

基于 DeepSeek V4 的终端 AI 编程智能体 DeepSeek TUI 在 GitHub 获 8700+ Star,支持思维链可视化、100 万 Token 上下文、16 路并发子任务。

DeepSeek V4 发布一周后,一个叫 DeepSeek TUI 的开源项目就登上了 GitHub 热榜第一,Star 数突破 8700。它做的事情很简单:用 DeepSeek 的一套完全替代 Claude Code,而且运行在本地终端里,成本极低。

DeepSeek TUI 是一个完全运行在本地终端里的 AI 编程智能体,由开发者 Hunter Bown 用 Rust 语言编写。它专为 DeepSeek V4 大模型打造,提供终端原生、长上下文、推理过程可视化的编程体验。

简单说:在终端里用 DeepSeek 替代 Claude Code。

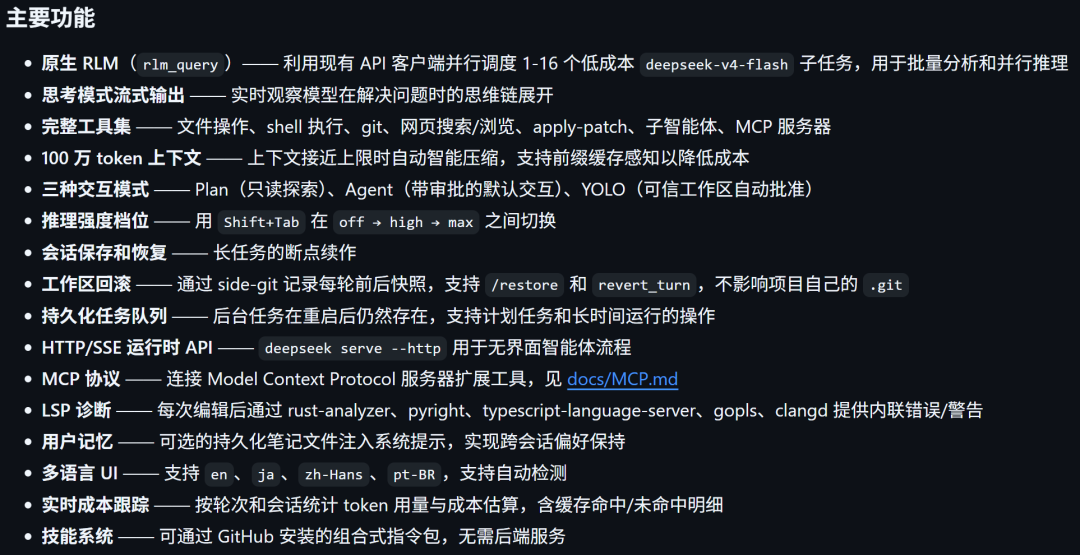

当你发出复杂命令时,DeepSeek TUI 会进入"思考模式"。DeepSeek 标志性的思维链(Chain of Thought)会实时流式输出到终端。你能看到模型怎么分析代码问题、走了哪条解决路径、是否中途自我纠错。整个"脑回路"对开发者完全透明。

DeepSeek V4 支持 100 万 Token 的上下文窗口,DeepSeek TUI 默认用满。配合上下文压缩机制,在跑复杂项目或重构整个代码库时不用担心"记忆断档"。

RLM(Recursive Language Model)模式是 DeepSeek TUI 的一个亮点。它利用 DeepSeek 低成本的特性搞并发调度,能同时驱动最多 16 个 V4 Flash 子任务跑批量分析。Flash 模型的输出价格仅为 Pro 模型的约三分之一,大幅降低整体 API 费用。

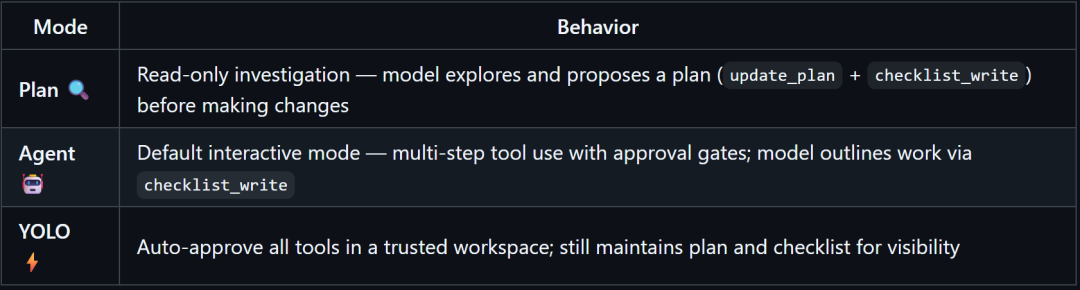

DeepSeek TUI 提供三档操作模式,适配不同使用场景:

| 模式 | 说明 | 适用场景 |

|---|---|---|

| Plan 模式 | 只读,输出任务拆解计划 | 梳理修改思路 |

| Agent 模式(默认) | 完整工具链权限,关键操作需手动确认 | 日常开发 |

| YOLO 模式 | 全自动,关闭所有审批弹窗 | 批量任务、快速原型 |

基于 DeepSeek TUI,你可以直接从终端完成以下操作:

所有操作都有可配置的审批门控,功能与 Claude Code 等商业工具媲美,但成本大幅降低。

| 维度 | Claude Code | DeepSeek TUI |

|---|---|---|

| 模型 | Claude 系列(需付费 API) | DeepSeek V4(低成本 API) |

| 开源 | 否 | 是(Rust 编写) |

| 上下文窗口 | 200K Token | 100 万 Token |

| 并发能力 | 单任务 | 最多 16 路 Flash 并发 |

| 思维链可视化 | 有限 | 完整实时流式输出 |

| 生态 | 成熟封闭 | 开放开源 |

# 克隆仓库

git clone https://github.com/Hmbown/DeepSeek-TUI.git

cd DeepSeek-TUI

# 按照项目 README 完成构建和配置

# 需要 Rust 环境和 DeepSeek API Key你需要准备:

为什么值得关注:在 Claude Code 几乎成为终端编码智能体标准的当下,DeepSeek TUI 打破了付费 API 和封闭生态的限制。它依托 DeepSeek V4 的低成本模型栈,以极低的成本提供了类似 Claude Code 的工作流程。对于预算有限或偏好开源方案的开发者来说,这是一个值得尝试的选择。

估值5亿的AI文档平台Mintlify,让文档同时服务于人类和AI,支持Markdown结构化内容、llms.txt机器目录和MCP实时查询,Anthropic、X、PayPal都在用。

用 Doubao Seed 2.0 Lite 全模态模型配合 Agent,实现视频自动转图文博客的四步工作流,解决传统 ASR+LLM 流水线丢失画面信息的问题。

GitHub 2.3k星的Rust开源终端编程工具,专为DeepSeek V4优化,支持思维链输出、子Agent调度和MCP服务器