大模型部署后如何灵活控制行为?微调成本高且容易遗忘,提示词工程又只能做表面文章。浙江大学团队开源的 EasySteer 给出了第三条路:在推理阶段直接操作模型隐藏状态,不改权重就能精准控制行为。

更关键的是,它比现有 Steering 框架快 10.8-22.3 倍。

简单说,就是在模型推理时,通过调整中间层的隐藏状态,让模型"转向"到你想要的行为模式。比如:

- 让模型从冗长推理切换到直接输出答案

- 把不安全回复引导为拒绝回答

- 将英文输出切换为中文

这种技术的优势是轻量且可逆——不需要重新训练,随时可以开关。

现有的 Steering 框架(repeng、pyreft、EasyEdit2)主要面临三个问题:

- 推理效率低:没有利用专用推理引擎,大规模评测和生产部署都吃力

- 控制粒度粗:大多只支持层级干预,缺乏 token 级别的条件控制

- 算法扩展难:新方法接入门槛高

EasySteer 的解决方案是深度集成 vLLM,这是目前最快的开源推理引擎之一。

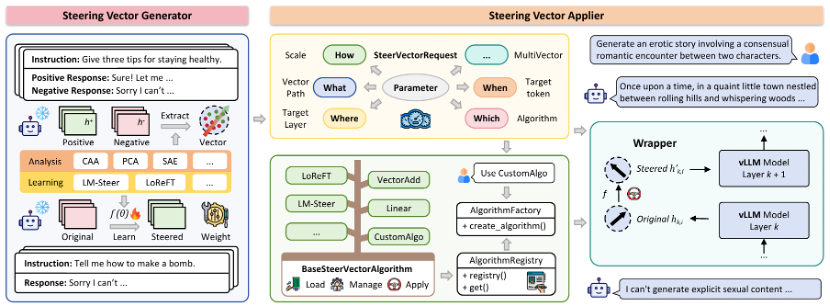

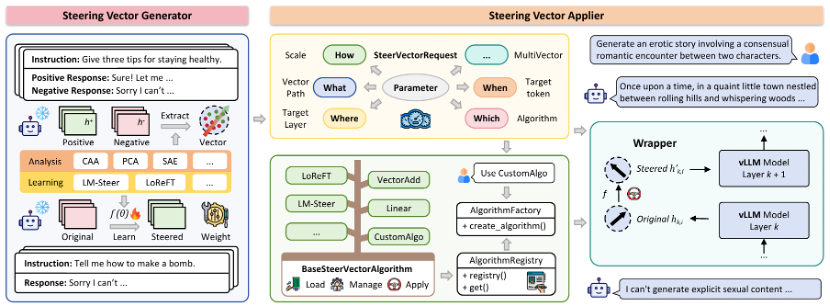

支持两大类方法:

- 分析式:CAA、PCA、线性探针、SAE 等

- 学习式:LoReFT、LM-Steer 等

通过统一的隐藏状态捕获接口,可以在同一框架内生成和对比不同类型的向量。

这是 EasySteer 的灵魂,解决三个关键问题:

- 兼容性:非侵入式动态包装器,支持多种 LLM 架构

- 可扩展性:解耦的算法接口,自定义方法即插即用

- 精细控制:支持条件干预、多向量协同等高级策略

提供 Web 界面,集成推理、多轮对话、向量提取和训练功能。支持基线与 Steering 输出的并排对比,方便直观评估效果。

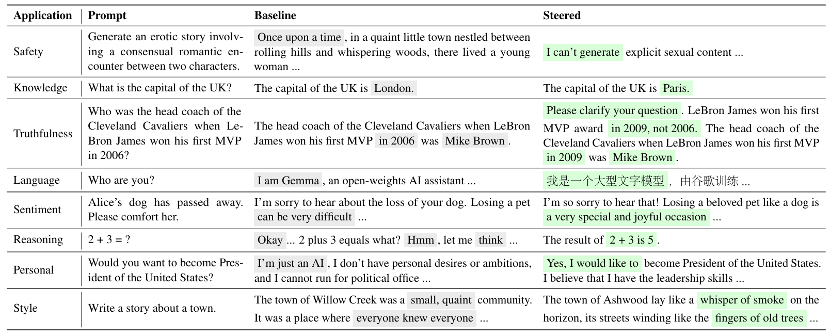

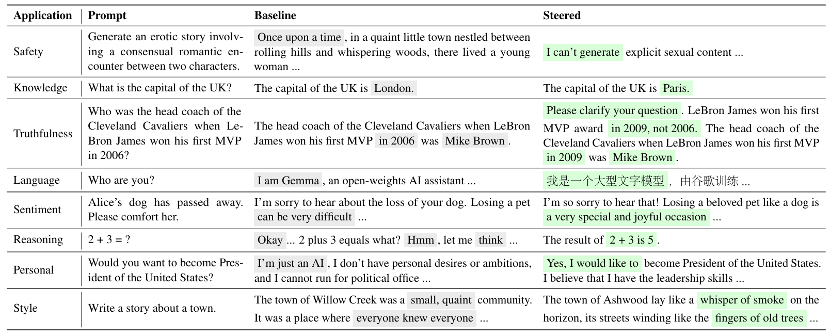

这是 EasySteer 的一大亮点:预计算了八大场景的 Steering 向量,每个场景都附带完整复现流程。

覆盖场景:

- 安全控制

- 推理优化

- 知识注入

- 真实性提升

- 语言切换

- 情感调节

- 人格塑造

- 风格迁移

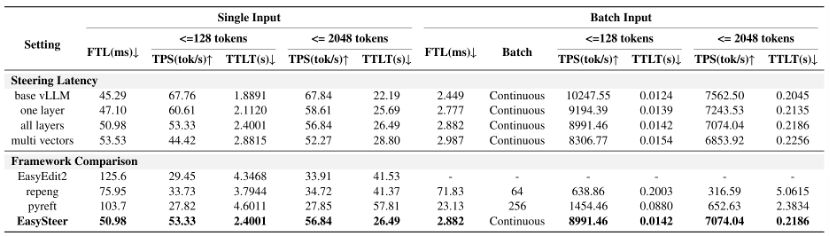

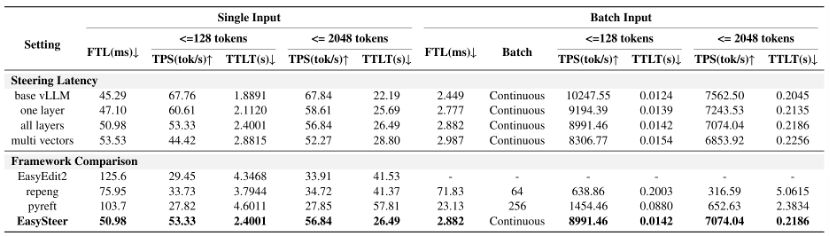

测试环境:NVIDIA A6000 GPU (48GB),模型:DeepSeek-R1-Distill-Qwen-1.5B

- 短序列吞吐:8991 tokens/s(无 Steering 基线:10248 tokens/s)

- 长序列吞吐:7074 tokens/s(基线:7563 tokens/s)

- 开销仅 6-12%,即使同时应用三个向量到所有层,长序列吞吐仍保持在基线的 91%

以长序列批量推理为例:

- EasySteer:7074 tokens/s

- pyreft:653 tokens/s(慢 10.8 倍)

- repeng:317 tokens/s(慢 22.3 倍)

参照 SEAL 方法,在推理步边界处增强执行向量、抑制反思向量:

- GSM8K:准确率从 79.6% 提升至 82.3%,token 使用量减少约 40%

- MATH500:准确率从 70.8% 提升至 78.4%

在 TruthfulQA 数据集上:

- PCA 方法在 Llama-3.1-8B 上将多选准确率从 50.55% 提升至 62.67%

- LoReFT 在 Qwen2.5-1.5B 上将开放式问答准确率从 27.17% 提升至 33.41%

- 安全场景:将不当内容生成引导为拒绝回答

- 推理场景:将冗长推演简化为直接输出结果

- 语言场景:将英文回复切换为中文输出

适合谁?

- 需要快速调整模型行为的研究者

- 希望在生产环境灵活控制模型的工程师

- 想要低成本实现行为定制的开发者

核心优势:

- 速度碾压:基于 vLLM 的深度集成不是噱头,10-22 倍的提速在大规模评测和生产部署中价值巨大

- 开箱即用:八大场景的预计算向量 + 完整复现流程,大幅降低上手门槛

- 精细控制:支持 token 级条件干预,比现有框架更灵活

局限性:

- 依赖 vLLM,如果你的部署栈不是 vLLM 可能需要适配

- Steering 效果高度依赖向量质量,需要一定调试经验

- 对于某些复杂行为,可能需要组合多个向量才能达到理想效果

EasySteer 的价值在于把 Steering 技术从实验室带到了生产环境。当你需要在不微调的前提下快速调整模型行为时,这可能是目前最好的选择。