面壁智能开源EdgeClaw框架,通过三级安全协同与性价比感知机制,解决OpenClaw数据泄漏和高成本问题

面壁智能开源EdgeClaw框架,通过三级安全协同与性价比感知机制,解决OpenClaw数据泄漏和高成本问题

OpenClaw 火了,但用户很快发现两个硬伤:个人数据会被上传到云端大模型,以及超长上下文导致 token 消耗惊人。

3月19日,面壁智能联合清华、人大等机构开源了 EdgeClaw——一个基于 OpenClaw 的安全高效端云协同智能体框架。核心卖点就两个字:安全 和 省钱。

EdgeClaw 最大的创新是三级安全分类,自动判断数据敏感程度:

技术实现上,EdgeClaw 使用了双检测引擎:

两个引擎可以叠加使用,灵活配置。更关键的是,EdgeClaw 维护了双轨记忆——云端模型只能看到脱敏后的对话历史,本地模型才能访问完整信息。

大部分 AI 编程助手的请求其实很简单——查文件、看代码、简单问答。用最贵的模型处理这些任务纯属浪费。

EdgeClaw 的做法是:用本地小模型做 LLM-as-Judge,把请求按复杂度分级路由到不同价位的云端模型。

实测数据显示,在典型编程助手工作流中,60-80% 的请求可以路由到更便宜的模型,成本直接砍半。

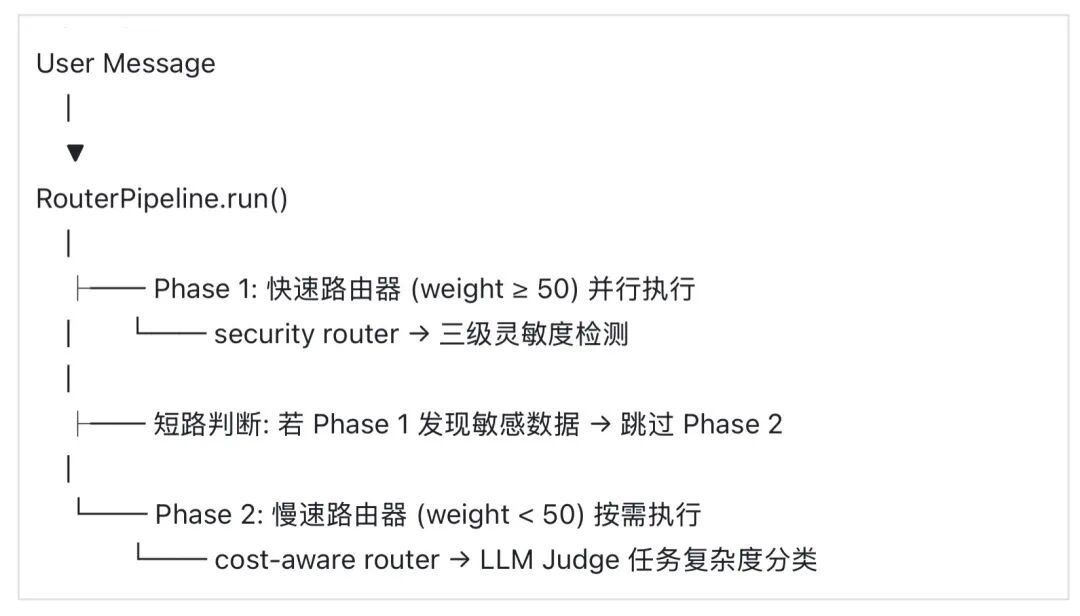

两个机制不是独立运行的,而是在同一管线中协同工作:

这种设计遵循安全优先原则——不会为了省钱牺牲数据安全。

EdgeClaw 以 OpenClaw 插件形式加载,开发者无需修改业务逻辑。配合端云协同的智能转发能力,实现"公开数据上云、敏感数据脱敏、私密数据落地"的无感切换。

目前已支持部署在 DGXSpark、MacMini 等桌面端设备上。

适合谁?

核心优势:

局限性:

团队透露后续会推出:

EdgeClaw 的出现,让"既要安全又要省钱"不再是二选一的难题。对于那些因为数据安全顾虑而不敢用 OpenClaw 的企业,这可能就是他们等待的解决方案。

GPT Image 2 疑似整合 GPT-4o,用 LLM 主导语义规划、扩散模型负责像素生成,实现文字准确渲染和多轮编辑一致性,代表了图像生成的新范式。

GitHub 2.3k星的DeepSeek-TUI,用Rust编写的终端编程工具,针对DeepSeek V4优化,支持100万token上下文、多子Agent并行、三种操作模式。

GPT-5.5驱动Codex实现全自动编程,50个并行Codex同时运行,全平台产品矩阵覆盖Mac、iOS和浏览器