京东开源 24B 参数图像模型,业内首个底层融合空间智能的一体化方案,支持相机控制、物体旋转与空间关系操控

京东开源 24B 参数图像模型,业内首个底层融合空间智能的一体化方案,支持相机控制、物体旋转与空间关系操控

大多数图像 AI 能画出漂亮的图片,却搞不定一个基本问题:空间。换个角度透视崩塌,挪个物体遮挡错乱。京东开源的 JoyAI-Image-Edit 把"空间智能"写进了模型架构底层,让图像编辑从平面修图走向真正的三维理解。

JoyAI-Image-Edit 是京东探索研究院开源的一体化图像模型,Apache 2.0 协议。它将一个 8B 参数的多模态语言模型(MLLM)和一个 16B 参数的多模态扩散 Transformer(MMDiT)耦合在一起,让"理解"和"生成"在同一个架构里形成闭环。

简单说:模型一边"看"一边"画",一边"画"又帮它看得更清楚。

![]()

核心论文标题直白地写明了野心 -- "Awakening Spatial Intelligence in Unified Multimodal Understanding and Generation"(在统一的多模态理解与生成中,唤醒空间智能)。

用自然语言告诉模型调整视角,比如"把相机往右偏 30 度,往下俯 15 度,再拉近一点"。模型会生成一张全新视角的图像,透视、遮挡、光影关系全部保持一致。

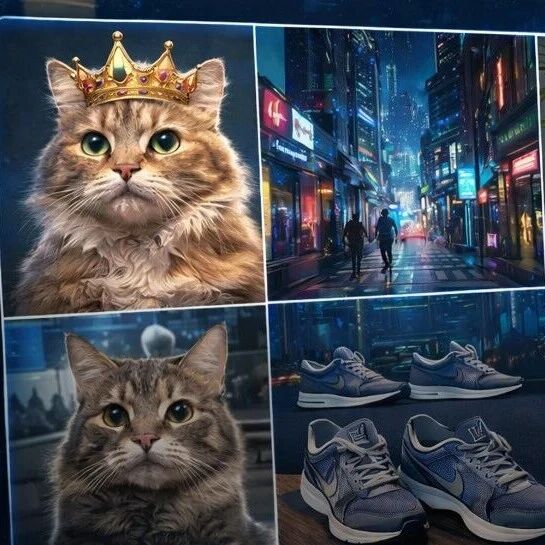

![]()

支持连续视角移动,生成逻辑连贯的多视角图像序列。比如让球鞋转到正面,让人物转到背面。

挪动、旋转、缩放画面中的任意物体,场景结构保持稳定,遮挡自然,光影过渡顺滑。

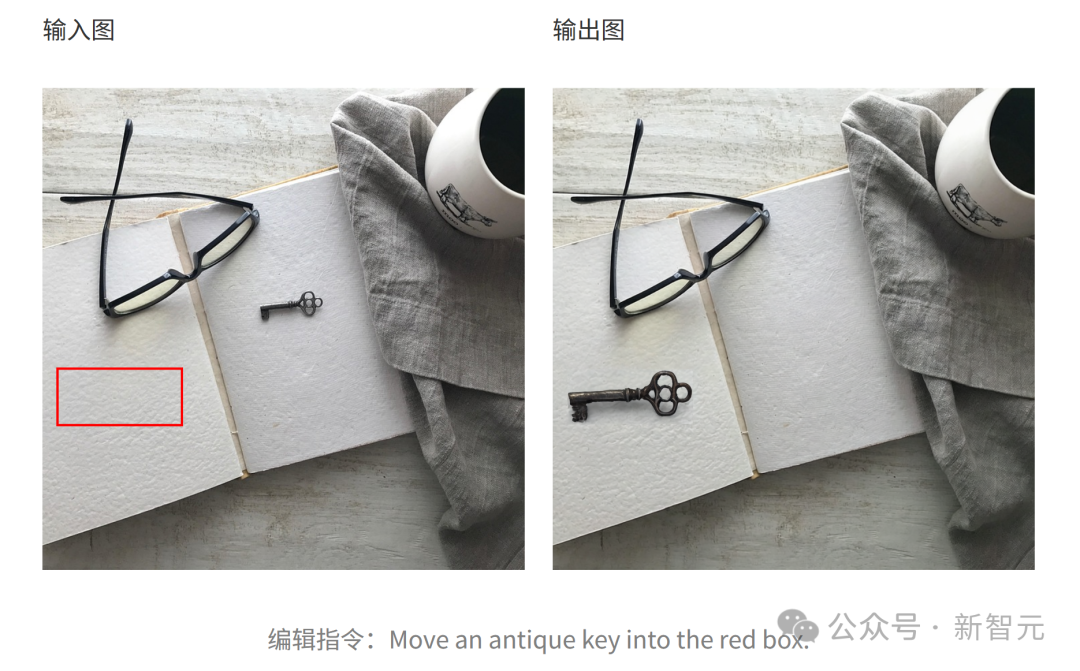

除了空间编辑,JoyAI-Image-Edit 还支持:替换、删除、添加、风格迁移、细节精修、长文本渲染等通用图像编辑操作。

![]()

输入一句指令就能给小猫戴上皇冠,或者将图片中的行人移走。长文本渲染也是拿手项。

HuggingFace Space 提供了在线 Demo,打开即用:

已支持 ComfyUI,全面兼容 Diffusers 格式:

# 克隆仓库

git clone https://github.com/jd-opensource/JoyAI-Image.git

# 安装依赖并运行推理

# 详见仓库 README电商:一张商品主图自动衍生几十种视角和场景,保持商品一致性。

视频创作:利用空间编辑生成视频首尾帧,再用视频生成模型创建平滑过渡。

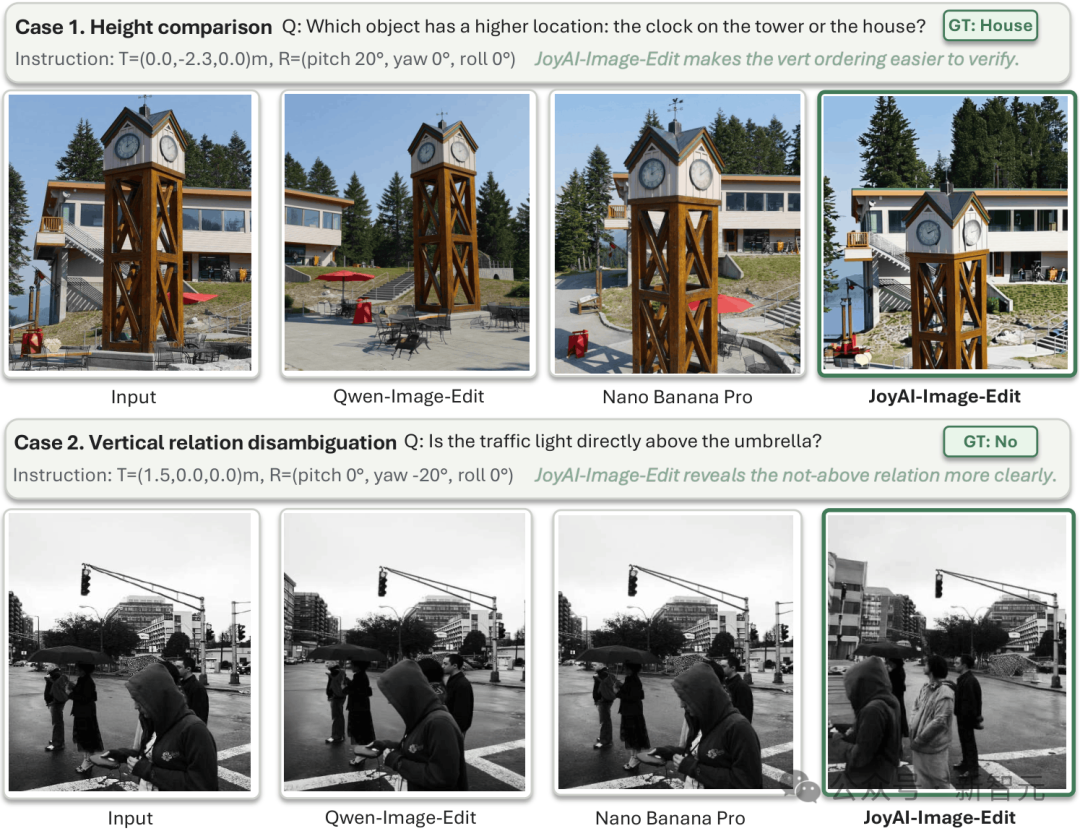

![]()

具身智能:机器人视觉感知的底座,支持"预演动作" -- 给机器人一张图片,模型能生成执行某个动作后的预期画面。

与 Qwen-Image-Edit、Nano Banana Pro 相比,JoyAI-Image-Edit 在相机运动执行忠实度和新视角合成质量上明显领先。高保真的新视角能有效消除复杂空间关系的歧义。

如果你在做电商视觉、机器人感知或需要精确空间控制的图像编辑,JoyAI-Image-Edit 值得立即上手试一试。