Andrej Karpathy 分享了他的 LLM Wiki 工作流,用 Markdown 文件 + Claude Code 替代复杂的 RAG 架构,构建可演化的个人知识库。

Andrej Karpathy 分享了他的 LLM Wiki 工作流,用 Markdown 文件 + Claude Code 替代复杂的 RAG 架构,构建可演化的个人知识库。

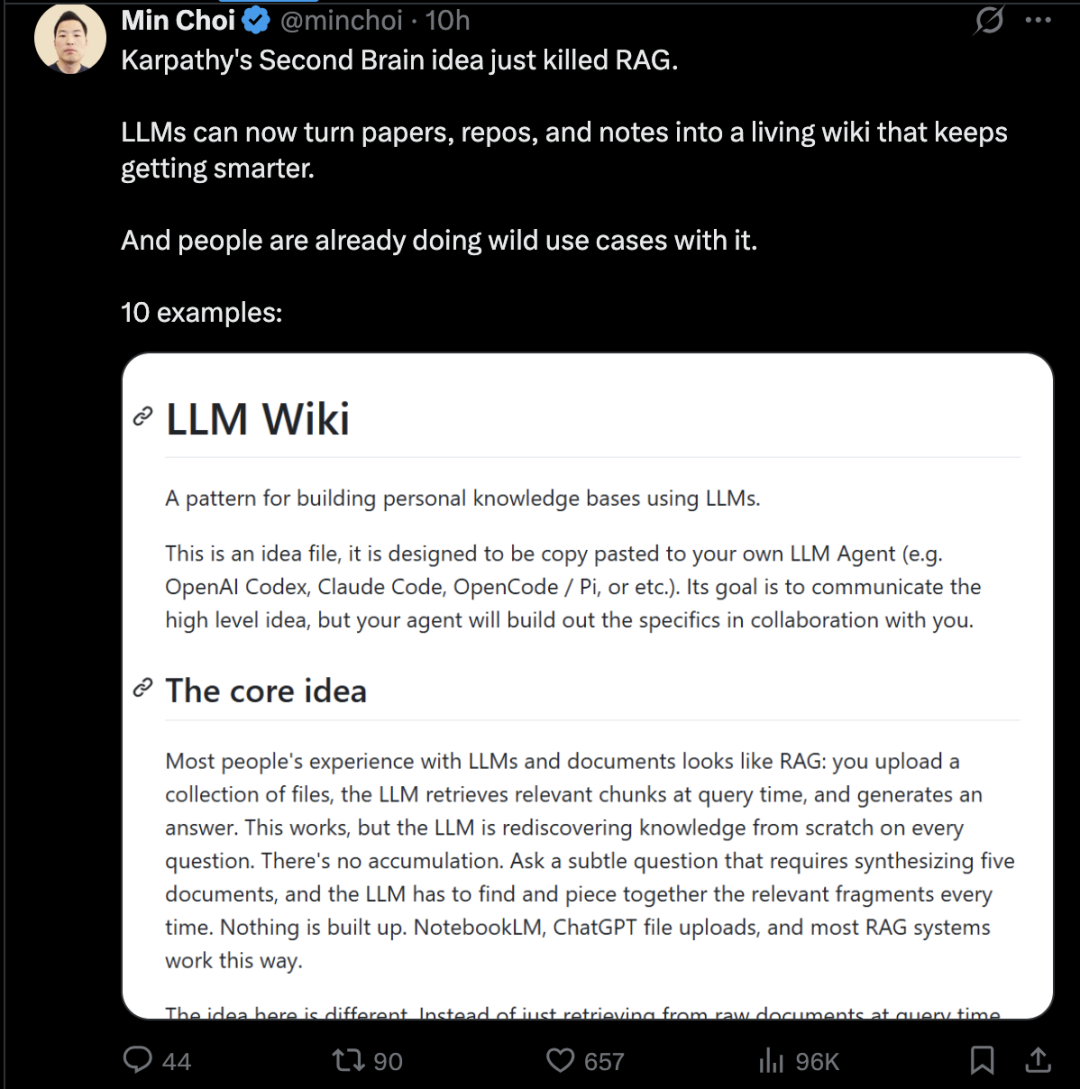

Andrej Karpathy 最近分享了一个他称之为 "LLM Wiki" 的工作流:不再把大模型主要用于写代码,而是将 Token 消耗在构建一个围绕个人研究兴趣的"可演化知识库"上。整个系统的架构极其简洁 -- 不需要数据库,不需要向量嵌入,不需要服务器,只需要 Markdown 文件和一个功能强大的模型。

这个思路的核心颠覆在于:在中等规模数据集上,LLM 本身已经具备足够的"自检索"和"自组织"能力,你可能不再需要复杂的 RAG 架构。

Karpathy 的架构只包含三个核心组件:

1. 一个 Markdown 文件文件夹

这就是你的知识库。可以包含任何内容:研究笔记、会议纪要、项目文档、读书笔记、代码片段。

2. 每个文件内部结构一致

优秀的 LLM Wiki 文档采用一致的内部格式 -- 标题、简短摘要、标签主题以及正文内容。模型利用这种结构更快地定位相关信息。

3. 使用 Claude Code 作为查询界面

打开终端,导航到你的 wiki 文件夹,启动 Claude Code,然后向它提问。Claude 会读取所需的文件,综合生成答案,甚至可以更新或添加笔记。

创建一个 raw/ 目录,将与研究主题相关的所有素材一股脑放进去:

这一步不需要任何结构设计,目标是最大化原始信息的完整性。

提示:使用 Obsidian Web Clipper 可以方便地将网页内容转为 Markdown,图片也会存储在本地,方便 LLM 通过视觉功能引用。

调用 LLM 对 raw/ 目录中的素材进行增量"编译",生成结构化的 Wiki 页面。编译过程包括:

这个 Wiki 本质上是一个由 AI 自动撰写和维护的知识百科系统,存储为结构化的 Markdown 文件集合。

Karpathy 把 Obsidian 作为这个系统的"前端 IDE",在这里可以:

核心原则:Wiki 中的所有数据都由 LLM 编写和维护,自己极少直接动手修改。

当知识库规模逐渐扩大(Karpathy 提到一个包含约 100 篇文章、总计 40 万字的项目),你可以直接向 LLM Agent 提出复杂的系统性问题。

与传统 RAG 不同,Karpathy 依赖的是 LLM 对 Wiki 的"内生理解"能力 -- 模型通过自动维护的索引与摘要,高效定位信息并综合分析。

定期调用 LLM 对整个 Wiki 进行"体检":

Karpathy 的方法与 RAG 的根本区别在于思路:

| 对比维度 | 传统 RAG | LLM Wiki |

|---|---|---|

| 数据处理 | 分块 + 向量嵌入 + 向量数据库 | Markdown 文件 + LLM 直接阅读 |

| 检索方式 | 相似性搜索 | LLM 内生理解 + 结构化索引 |

| 可追溯性 | 向量嵌入是"黑箱" | 每条声明可追溯到具体 .md 文件 |

| 维护成本 | 需要向量数据库和嵌入服务 | 只需要文件系统 |

Karpathy 把 Markdown 文件视为"真理之源"。AI 做出的每一项声明都可以追溯到特定的文件,而你可以阅读、编辑或删除这些文件。

Karpathy 提到的下一步演化方向:通过合成数据生成与微调,将结构化知识"压缩"进模型权重。从依赖上下文窗口的外部知识系统,迈向模型内部的长期记忆。

社区也已经开始将这个思路产品化。有人推出了 Claudeopedia 等工具,在 Karpathy 方案的基础上增加了交互式可视化界面和定时自动复核功能。

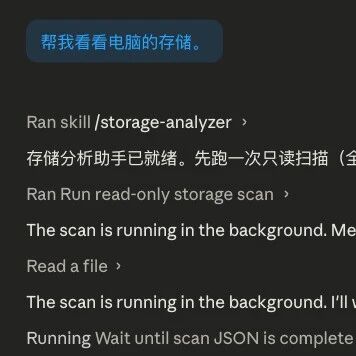

OpenSquilla 推出 Meta Skill 功能,一个 Skill 内嵌多个子 Skill,能端到端打通长程工作流,还能省 60-80% 的 Token 成本

一个开源的电脑清理 Skill,让 Agent 对 Mac/Windows 进行只读分析,生成可视化 HTML 报告并分级清理,实测清出 120G 空间。

从零开始掌握 OpenAI Codex 桌面版,涵盖安装配置、界面解读、项目创建、技能与插件使用,以及手机远程控制的保姆级教程