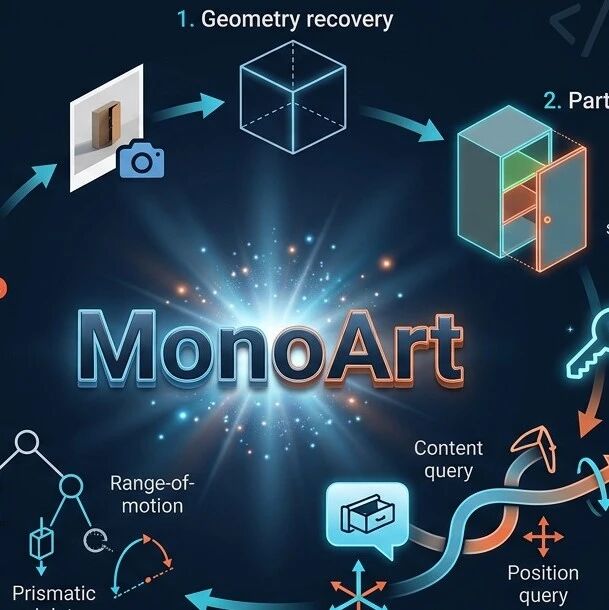

南洋理工大学开源 MonoArt 框架,从单张图片生成具备关节、运动能力的3D模型,无需多视角或外部数据,推理仅需20秒

南洋理工大学开源 MonoArt 框架,从单张图片生成具备关节、运动能力的3D模型,无需多视角或外部数据,推理仅需20秒

现有的 3D 生成工具可以从单张图片生成 3D 模型,但生成的模型大多是焊死的静态资产。你想打开冰箱门?不行。你想让机器人搬动椅子?它不知道哪里可以折叠。

南洋理工大学 S-Lab 团队开源的 MonoArt 解决了这个问题:从单张图片生成既有形状、又有部件层级和关节信息的可交互 3D 模型。整个过程不需要多视角数据、不需要外部资产库、不需要辅助视频生成,推理只需要约 20 秒。

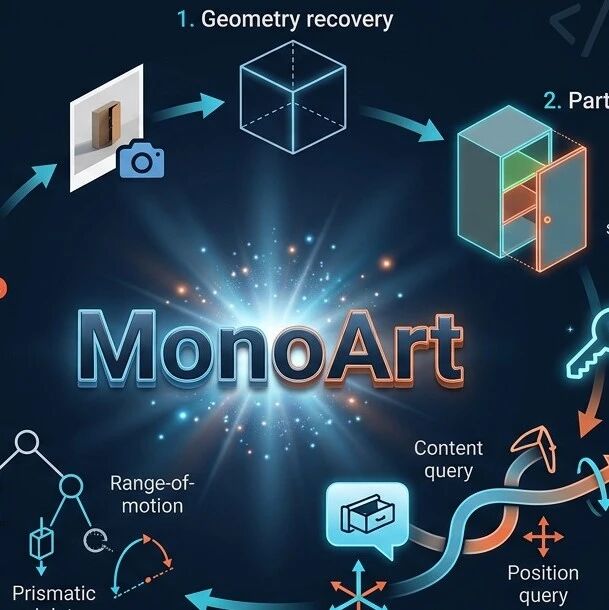

MonoArt 将单目可动物体重建建模为一个渐进式结构推理过程。模型不是一次性猜测物体怎么动,而是依次完成四个步骤:

最终输出一个既有形状、又有部件层级和关节信息的完整 3D 表示。

使用 TRELLIS 作为冻结的 3D 生成骨干,从单张图像输出一个标准网格(canonical mesh)以及对齐的潜在特征。后续所有关于部件和运动的推理,都建立在三维空间而非二维图像上。

一个柜子的门和柜体是不同的部件,但网格本身不会告诉你这一点。MonoArt 使用 Part-Aware Semantic Reasoner 让模型"看懂"部件结构:

训练前后的对比很直观:没有这个模块时,点特征难以区分不同部件;加上模块和监督后,不同部件的特征有了清晰边界。

MonoArt 使用 Dual-Query Motion Decoder 做了一个解耦设计:

这种"一边搞清楚是什么,一边搞清楚在哪里"的并行迭代方式,让运动推理更稳定。

最终输出:

💡 设计细节: 关节位置的预测采用残差形式,以上一步的 position query 为锚点,只预测偏移量。实验表明这比直接回归绝对坐标更准确。

在 PartNet-Mobility 基准测试中,MonoArt 在 7 类和 46 类两种设置下均取得领先性能。

| 方法 | 推理时间 | 外部依赖 |

|---|---|---|

| MonoArt | 20.5 秒 | 无 |

| Articulate-Anything | 229.9 秒 | VLM + 辅助视频 |

| PhysXAnything | 256.8 秒 | 外部先验 |

其中 MonoArt 的 18.2 秒花在 TRELLIS 做 3D 重建上,关节推理(articulation reasoning)本身只增加了约 2 秒。

MonoArt 对以下场景特别有价值:

目前 MonoArt 仍有一些限制:

如果你在做具身智能、游戏开发或 AR/VR 相关项目,MonoArt 提供了一种从单张图片快速获取可交互 3D 资产的方案。20 秒的推理速度意味着它可以被集成到实时工作流中。

NVIDIA开源Lyra 2.0,单张2D图片直出3D高斯泼溅场景,支持持久探索和回访,可直接导出到物理引擎。

星流智能图片V2支持批量素材生成、编辑元素拆图、文字编辑、HD放大等功能,可理解为Lovart中文版,国内直接使用。

开源项目awesome-gpt-image-2逆向工程329条GPT-Image-2提示词,提供JSON/YAML结构化模板,支持Agent批量出图零幻觉。