NVIDIA开源Lyra 2.0,单张2D图片直出3D高斯泼溅场景,支持持久探索和回访,可直接导出到物理引擎。

NVIDIA开源Lyra 2.0,单张2D图片直出3D高斯泼溅场景,支持持久探索和回访,可直接导出到物理引擎。

NVIDIA发布了Lyra 2.0并完全开源。你只需要上传一张普通的2D图片,它就能生成一个可以四处走动、回头张望的3D交互世界。这不是简单的2D转3D——生成的是完整的3D高斯泼溅(Gaussian Splatting)场景和表面网格,可以直接导出到物理引擎用于机器人仿真。

简单说:一张照片 -> 一个可探索的3D世界。

Lyra 2.0以Wan 2.1-14B(140亿参数的扩散Transformer)作为视频生成底座,通过三步流水线完成从图片到3D世界的转换:

这是Lyra 2.0最核心的突破。过去所有"长时程3D生成"方法都面临两个致命问题:

Lyra 2.0的解法:

消融实验验证了这两项技术的必要性:去掉抗遗忘机制,回访区域出现严重幻觉;去掉自增强训练,长轨迹上漂移肉眼可见。

在DL3DV和Tanks and Temples两个经典基准上,Lyra 2.0全面超越所有基线方法。相比Lyra 1.0(2025年9月发布),2.0实现了从"短视频3D重建"到"大规模持久世界生成"的跃升:

生成的3D高斯泼溅和网格模型可以直接导出到物理引擎,包括NVIDIA自家的Isaac Sim,用于:

提示:Lyra 2.0目前本质上是"记忆+补全",不真正理解场景的物理结构。推倒一面墙不会影响隔壁房间,水不会往低处流。它更像是视觉想象力极强的场景生成器,而非物理世界模拟器。

所有资源完全免费开源:

Anthropic为Claude新增交互式图表和流程图功能,免费用户可用,支持生成可点击的周期表、时间线、决策树等可视化内容。

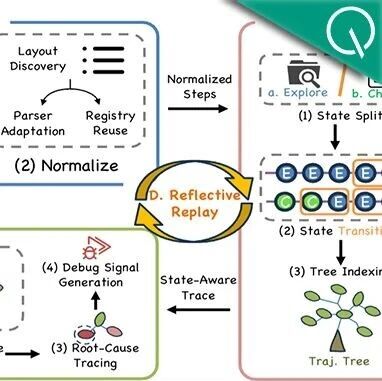

南大快手联合提出CodeTracer框架,无需重训即可自动定位Coding Agent失败节点,F1分数比基线提升近30个百分点。

开源项目awesome-gpt-image-2逆向工程329条GPT-Image-2提示词,提供JSON/YAML结构化模板,支持Agent批量出图零幻觉。