DeepSeek V4 开源发布,MIT协议,100万token上下文,输出每百万token仅3.48美元。实测编程成本骤降83%,是迁移的最佳窗口期。

DeepSeek V4 开源发布,MIT协议,100万token上下文,输出每百万token仅3.48美元。实测编程成本骤降83%,是迁移的最佳窗口期。

DeepSeek V4 来了。MIT 开源协议、100 万 token 上下文窗口、输出每百万 token 仅 3.48 美元——大约只有 GPT-5.5 的十分之一。更重要的是,实测显示它的编码能力击败了 Claude Opus 4.6 和 GPT-5.4。如果你正在考虑从 Claude 或 GPT 迁移,这是最佳窗口期。

DeepSeek V4 系列包含两个模型:

| 模型 | 参数规模 | 激活参数 | 定价(每百万token) |

|---|---|---|---|

| DeepSeek-V4-Pro | 1.6T | 49B | 输入 $5.22 / 输出 $3.48 |

| DeepSeek-V4-Flash | 284B | 13B | 输入 $0.14 / 输出 $0.28 |

注意:以上为标准 API 价格。缓存命中时,V4-Pro 输入降至 $0.145,V4-Flash 输入降至 $0.02。V4-Pro 当前限时优惠 75%(截至 5 月 5 日),缓存命中价格为永久降价。

同样处理 100 万输入 token + 100 万输出 token 的成本:

主流模型 API 定价对比,DeepSeek V4-Flash 成本不到 GPT-5.5 的 2%

科技博主 Sean Donahoe 分享了他的迁移经验:不需要 OpenRouter,不需要代理,直接使用 DeepSeek 原生 API。

Claude Code 配置示例:

# 设置 DeepSeek API 端点

export DEEPSEEK_API_KEY="your-api-key"

export DEEPSEEK_BASE_URL="https://api.deepseek.com"

# 在 Claude Code 中配置自定义模型端点

claude config set model deepseek-v4-pro

claude config set apiBase https://api.deepseek.com

claude config set apiKey $DEEPSEEK_API_KEYCursor 配置:

打开 Settings -> Models -> OpenAI API Key,填入 DeepSeek 的 API Key 和 Base URL https://api.deepseek.com,选择模型 deepseek-v4-pro。

提示:如果你同时使用多个工具,建议先用 V4-Flash 做日常轻量任务(更便宜),V4-Pro 留给复杂编码和推理任务。

DeepSeek V4 的缓存命中率非常高(V4-Pro 约 95%,V4-Flash 约 91%),这意味着大部分 token 都按缓存命中价格计费。

# 检查你的 API 用量和缓存命中率

import requests

response = requests.get(

"https://api.deepseek.com/usage",

headers={"Authorization": f"Bearer {API_KEY}"}

)

print(response.json())建议先用同一个任务在两个模型上各跑一遍,对比效果和成本。

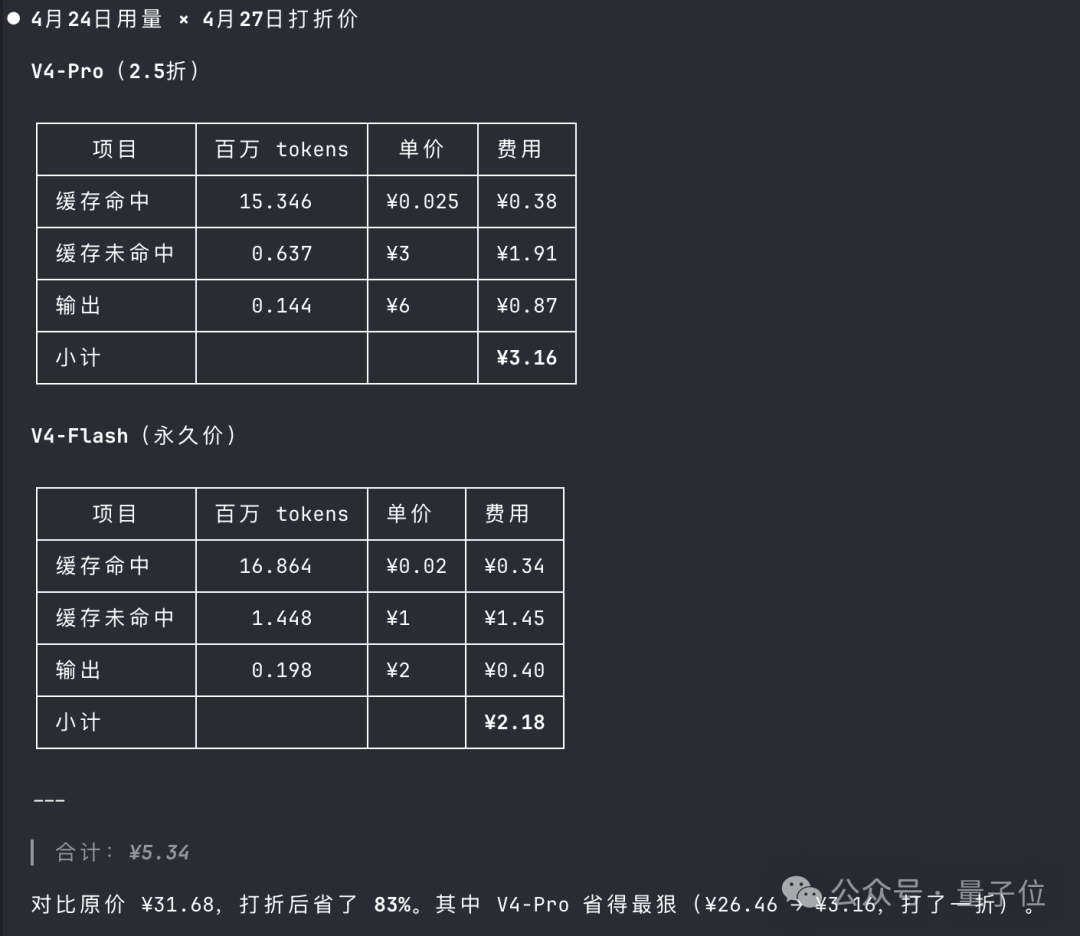

量子位的实测数据:3500 万 token 的编程任务,打折前花费 31.73 元,打折后仅需 5.34 元,整体节省约 83%。

DeepSeek V4 打折前后成本对比,整体节省 83%