英伟达推出开源多模态推理模型,融合文本、视觉、语音,吞吐量达同类9倍,免费可用,支持本地至云端全场景部署

英伟达推出开源多模态推理模型,融合文本、视觉、语音,吞吐量达同类9倍,免费可用,支持本地至云端全场景部署

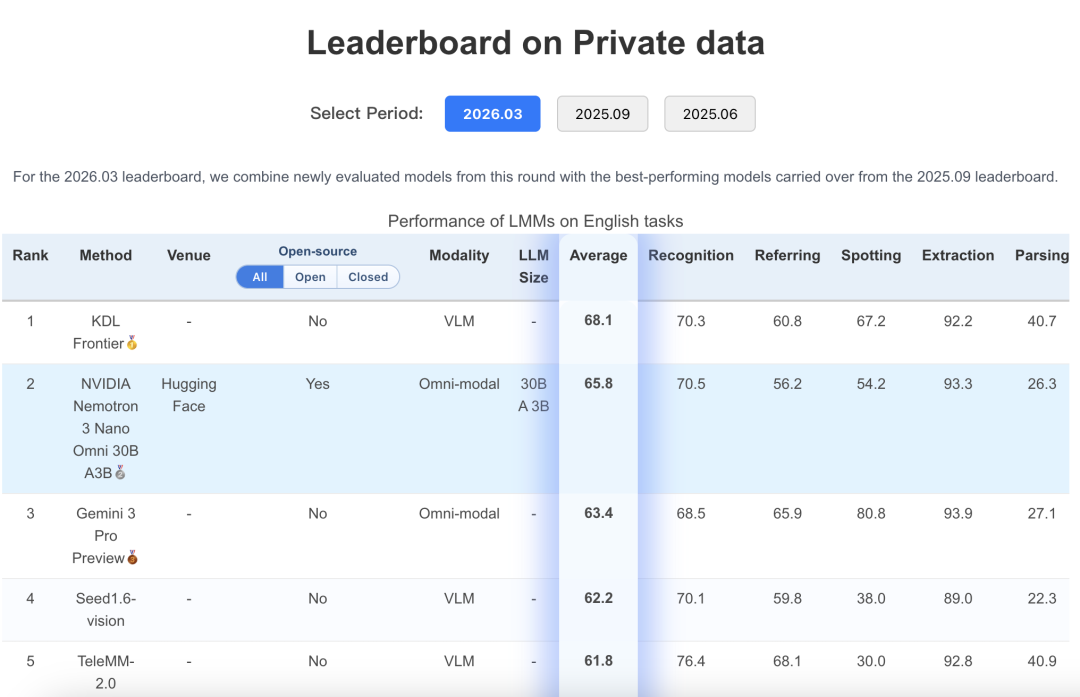

英伟达推出Nemotron 3 Nano Omni,一个在单一模型体系内融合文本、视觉、语音三大模态的开源推理模型。它的核心卖点是:吞吐量达到同类开放多模态模型的9倍,而且完全免费。如果你需要一个能同时处理视频、音频、文档、图片的轻量级模型,这个值得试一试。

Nemotron 3 Nano Omni可以处理以下输入类型:

模型以文本形式输出。它可以根据不同任务与模态动态激活专家网络(MoE架构),在保证高吞吐的同时实现强多模态感知。

吞吐量是同类9倍

这得益于混合型MoE核心架构,创新性地将Mamba层与Transformer层深度融合。Mamba层负责提升序列处理效率与内存利用率,Transformer层保障精准的推理计算。整体内存和计算效率最高提升4倍。

在视频推理场景中,与替代的开放式全向模型相比,有效系统容量提高约9.2倍。在多文档推理中,提高约7.4倍。

基准测试成绩亮眼

根据海外用户实测:

免费在线体验:

开源地址:

部署方式:

支持本地系统、数据中心和云环境部署,以满足监管、主权或数据本地化要求。

目前市场上暂无竞品同时具备以下全部特性:

对比来看:谷歌端侧模型Gemini Nano未开源,Meta Llama多模态版本无法在统一架构内整合音频处理能力。Nemotron 3 Nano Omni填补了这个空白。

开源Agent文档维护工具,自动审查项目文档体系并迭代更新,支持Claude Code、Codex、OpenCode、OpenClaw四个平台

小米开源MiMo-V2.5和MiMo-V2.5-Pro两大模型,支持1M上下文、Token效率行业领先,附100万亿Token免费计划

8B参数开源多模态模型,砍掉视觉编码器和VAE,支持信息图生成、连续图文交错输出,本地可部署,性能直逼GPT-Image-2