DeepSeek V4 开源发布,1.6T 参数、百万上下文,Agent 编程能力接近 Opus 4.6,附 API 定价、实测案例与上手地址

DeepSeek V4 开源发布,1.6T 参数、百万上下文,Agent 编程能力接近 Opus 4.6,附 API 定价、实测案例与上手地址

2026年4月24日,DeepSeek 正式发布并开源 DeepSeek-V4 系列。这个 1.6T 参数的开源巨无霸在 Agent 编程、长上下文和复杂推理上全面升级,发布当天即登顶 Hugging Face 热榜第一。本文整理了核心规格、API 定价和多维度实测结果,帮你快速判断是否值得切换。

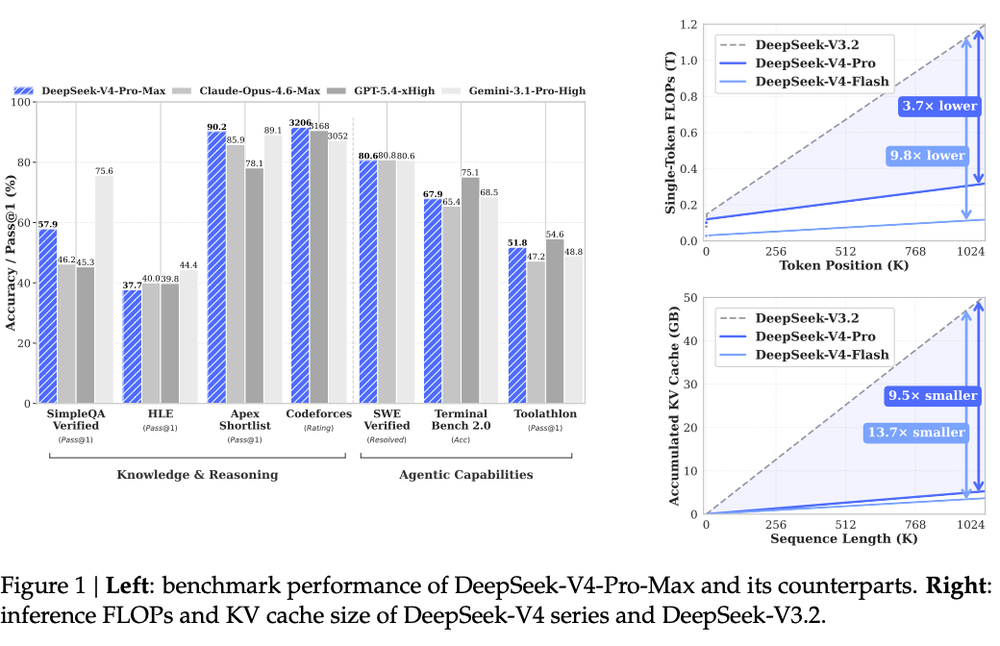

DeepSeek-V4 系列包含两个版本,均采用 MoE(混合专家)架构:

| 规格 | DeepSeek-V4-Pro | DeepSeek-V4-Flash |

|---|---|---|

| 总参数 | 1.6T | 284B |

| 激活参数 | 49B | 13B |

| 上下文长度 | 100 万 token | 100 万 token |

| 定位 | 对标闭源旗舰 | 低延迟、低成本 |

在 100 万 token 场景下,V4 的单 token 推理计算量仅为 V3.2 的 27%,KV Cache 占用降至约 10%。

| 计费项 | V4-Pro | V4-Flash |

|---|---|---|

| 输入(命中缓存) | 1 元/百万 tokens | 0.2 元/百万 tokens |

| 输入(未命中缓存) | 12 元/百万 tokens | 1 元/百万 tokens |

| 输出 | 24 元/百万 tokens | 2 元/百万 tokens |

V4-Flash 的价格非常激进 -- 缓存命中时 0.2 元/百万 tokens,适合高频调用的轻量任务。

注意:DeepSeek 官方说明,受限于高端算力,V4-Pro 的服务吞吐目前有限。预计下半年昇腾 950 超节点批量上市后价格会大幅下调。

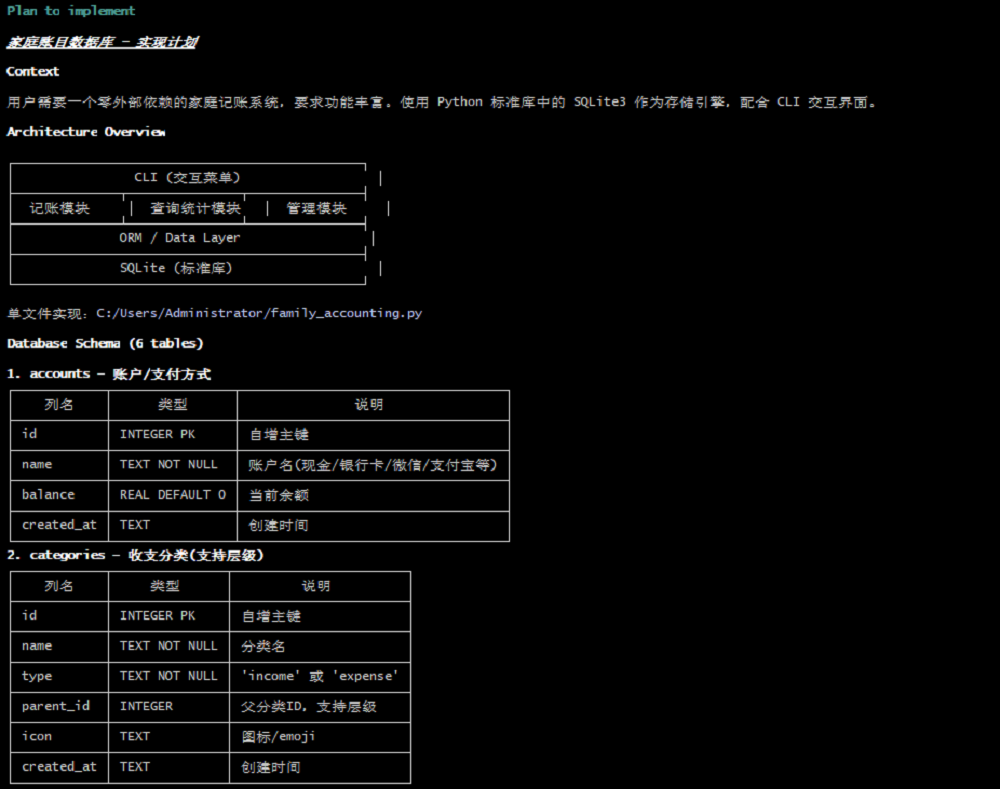

测试者给 DeepSeek-V4-Pro 一个模糊的数据库设计需求,模型先自主规划了包含 8 个功能模块和 6 张数据表的方案,然后列出 10 项验证清单。

规划完成后完全放手让它执行:连续编程接近 60 分钟,没有中断、没有死循环、没有遗漏关键步骤。前端所有核心功能运转正常,前后端数据交互链路完整。

这个任务消耗约 20 万 tokens(大部分为输入),API 账单约 5 元。由于缓存机制介入,实际成本可控。

这个任务的复杂度超出了模型的知识范围,但它自主开启了联网搜索,进行了 18 次工具调用,思考 11 分钟后输出完整的七步开发计划。最终连续跑 50 多分钟完成。

关键表现:模型在遇到知识盲区时会主动搜索补充,而不是胡编乱造。

上传《三体》三部曲全文,消耗 54 万 tokens。模型能准确回答关于书中情节细节的问题,验证了百万上下文的实际可用性。

GPT-5.5 正式发布,Terminal-Bench 82.7% 夺冠,1M 上下文翻倍提升,Codex 搭配 gpt-image-2 开启图像驱动开发新工作流

阶跃星辰发布新一代语音识别模型,推理速度提升 400%,支持 30 分钟音频一次性转写,定价仅为上代的 1/10

DeepSeek-V4与GPT-5.5同一天发布,开源对闭源的正面硬刚。推理、编程、长文本实测对比,帮你快速判断该用哪个。